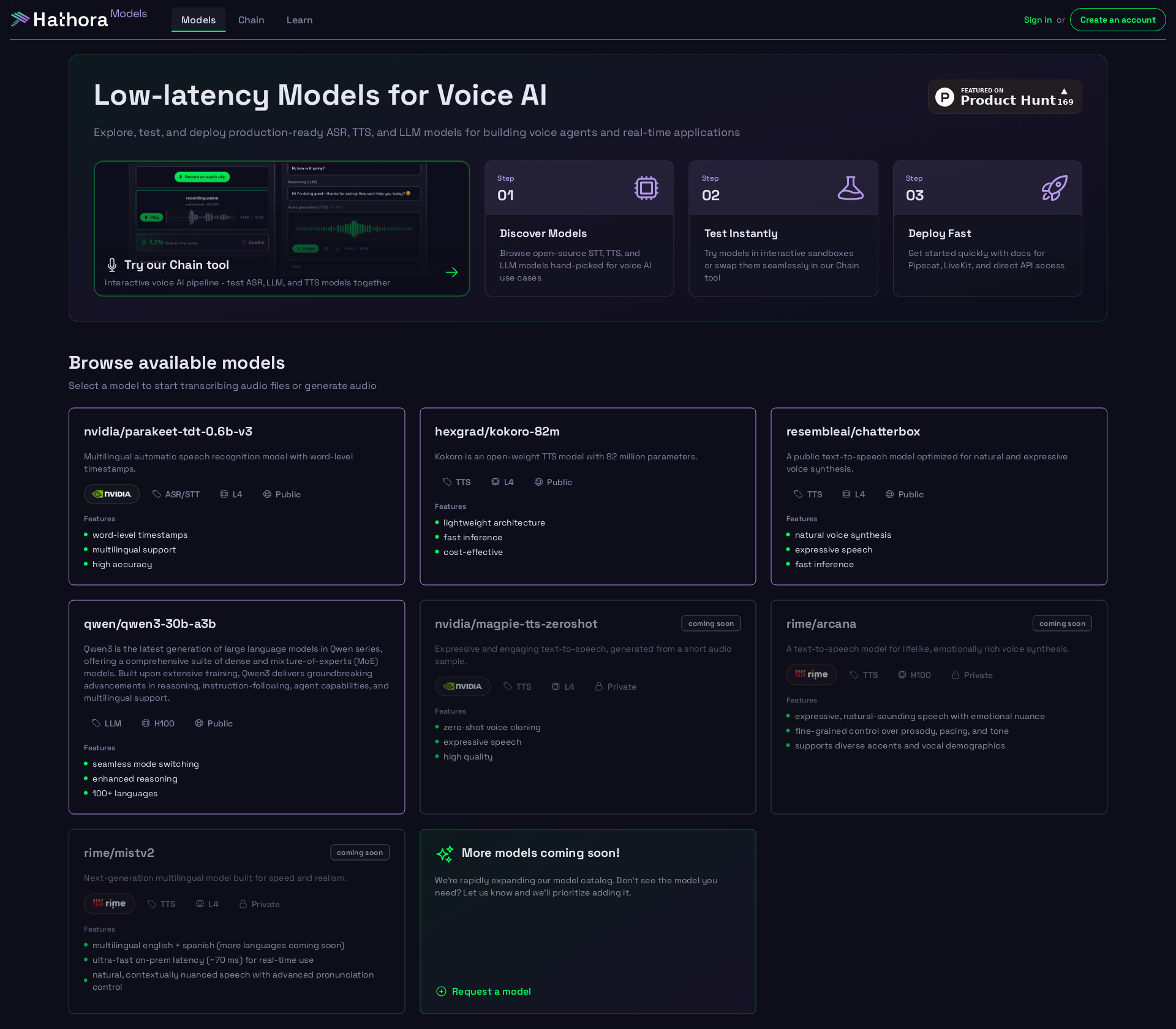

Hathora:零 DevOps 部署生产级语音 AI 模型的平台

Hathora 官方网站 是一款专注于语音 AI 的模型部署平台,支持开发者快速探索、测试并部署生产就绪的语音识别(ASR)、文本转语音(TTS)和大语言模型(LLM),无需 DevOps 配置即可构建语音代理和实时应用。

产品概览

Hathora 为开发者和企业提供一站式的语音 AI 模型部署解决方案,支持开源和闭源模型,旨在降低语音应用开发的门槛。用户可从共享端点快速开始,并根据隐私、合规或 VPC 需求升级至专用基础设施。平台覆盖全球 14 个区域,确保超低延迟的模型推理体验。

核心能力与特性

模型发现与测试

- 精选模型库:提供针对语音 AI 用例精心挑选的开源 STT、TTS 和 LLM 模型,如 NVIDIA Parakeet(带词级时间戳的多语言 ASR)、Hexgrad Kokoro(轻量 TTS)和 Qwen3-30B(多语言 LLM)。

- 交互式测试:支持在沙盒环境中即时测试模型,或通过 Chain 工具无缝切换并组合 ASR、LLM 和 TTS 模型,构建完整语音流水线。

部署与扩展

- 零 DevOps 部署:无需基础设施配置,即可快速部署模型至生产环境。

- 灵活基础设施:支持从共享端点起步,按需升级至专用资源,满足隐私与合规要求。

- 多区域低延迟:模型运行在 14 个全球区域,优化实时应用的延迟表现。

- 自定义模型支持:支持用户自带模型或自定义容器,便于扩展定制需求。

开发者工具集成

- API 与 SDK 支持:提供与 Pipecat、LiveKit 等语音框架的文档集成,支持直接 API 访问。

- 演示与示例:提供 Chain 工具交互演示,帮助用户快速理解模型组合与流水线构建。

性能与基础设施

Hathora 强调超低延迟和全球覆盖,模型推理服务部署在 14 个区域,确保语音应用的实时响应。平台支持公有和私有模型部署,其中部分模型(如 Rime Arcana、Mistv2)提供专有优化,实现约 70 毫秒的本地延迟,适用于实时交互场景。

隐私与数据安全

由开发者在平台中声明,支持升级至专用基础设施以满足隐私、合规或 VPC 要求,具体数据收集与分享策略可能随版本变化,建议用户参考官方政策文档。

典型使用场景

- 语音代理开发:组合 ASR、LLM 和 TTS 模型,构建智能语音助手或客服机器人。

- 实时语音应用:利用低延迟基础设施开发实时转录、语音合成或多语言交互应用。

- 企业级部署:通过专用基础设施满足数据隐私、合规或内部网络集成需求。

上手与资源

- 立即体验:访问 Hathora 官方网站 浏览模型并测试 Chain 工具。

- 开发者文档:查看 Pipecat 和 LiveKit 集成指南。

- 模型请求:如需特定模型,可通过平台提交添加请求。

小结

Hathora 通过简化模型部署流程和提供全球低延迟基础设施,降低了语音 AI 应用的开发现槛。无论是初创项目还是企业级需求,均可借助其灵活部署选项和丰富模型库快速构建生产级语音解决方案。建议开发者访问官网探索模型并体验交互演示。

评论区